A mesterséges intelligencia legújabb fejlesztései nemcsak kifinomultabb és intelligensebb chatbotokat hoztak, hanem jelentős kihívásokat is hoztak, különösen a mélyhamisítások térnyerésével. Míg a mesterséges intelligencia-leképezések közül sok utólag generált, az új egy valós idejű AI arccserével rendelkezik, amely videohívások során használható.

A Deep-Live-Cam nevű új mesterséges intelligencia-projekt a közelmúltban elterjedt az interneten a webkamerákra vonatkozó mélyhamisítások alkalmazására vonatkozóan. Ugyanakkor ez vitákat váltott ki a lehetséges biztonsági kockázatokról és etikai vonatkozásairól.

Miben különbözik a Deep-Live-Cam a többi mélyhamisító programtól

A Deep-Live-Cam alapvetően fejlett mesterséges intelligencia-algoritmusokat használ, amelyek egyetlen forrásból készíthetnek fényképet, és az arcot a célpontra alkalmazhatják élő videohívások során, például webkamerákon. Amíg a projekt még fejlesztés alatt áll, a kezdeti tesztek már aggasztó és lenyűgöző eredményeket mutatnak.

Amint azt az Ars Technicán is leírtuk, az alkalmazás először olvassa be és érzékeli az arcokat a forrásból és a céltárgyból. Ezután egy cseremodellt használ az arcok valós idejű cseréjéhez, míg egy másik modell javítja az arcok minőségét, és olyan effektusokat ad hozzá, amelyek alkalmazkodnak a változó fényviszonyokhoz és az arckifejezésekhez. Ez a kifinomult eljárás biztosítja, hogy a végtermék rendkívül valósághű legyen, és ne legyen könnyen felismerhető hamisítvány.

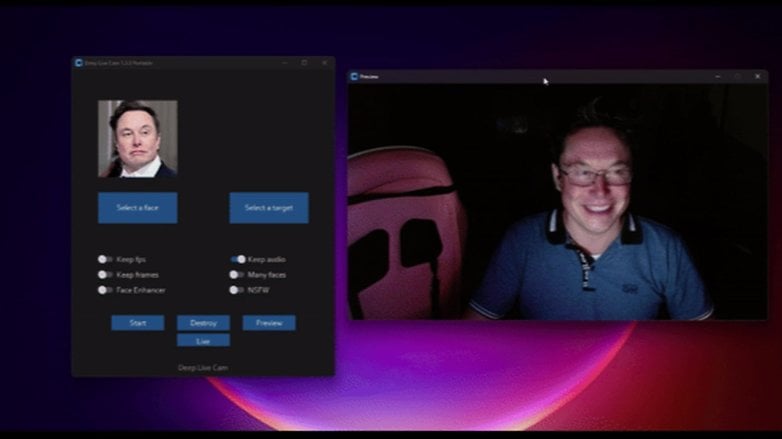

Példa egy arcfúzióra Elon Musk forrásként / © GitHub / Ars Technica

Például az egyik fejlesztő által megosztott klip a Tesla vezérigazgatója, Elon Musk arcának valósághű fúzióját mutatta be egy témával. A mélyhamisítás még dioptriás szemüveget és az alany haját is tartalmazta, ami hihetetlenül meggyőzővé tette. Egy másik bemutatott példa az amerikai alelnökjelölt, JD Vance és a Meta Mark Zuckerberg arca volt.

JD Vance amerikai alelnökjelölt arcfúziója Deep-Live-Cam segítségével / © X/u/Orange AI

Aggódnia kell az AI-szimulációs alkalmazások térnyerése miatt?

Szóval, miért érint ez konkrétan? A Deel-Live-Cam és más valós idejű mélyhamisítású alkalmazások használata komoly aggályokat vet fel az adatvédelemmel és a biztonsággal kapcsolatban. Képzelje el, hogy egy képet elkaphat az internetről, és csalásra, megtévesztésre és más rosszindulatú tevékenységekre használhatja fel az Ön engedélye nélkül.

Jelenleg látható, hogy a hiányosságokat néhány módon lehet orvosolni, például vízjelek beépítésével az alkalmazás használatakor és a robusztus észlelési módszerek segítségével. A megoldás más mélyhamisító programokra és alkalmazásokra is alkalmazható.

Az eszköz iránti érdeklődés gyorsan felvette a GitHub felkapott projektjei közé.

Mi a véleménye a valós idejű AI-szimulációs alkalmazásokról? Vannak gyakorlatai, amelyeket megoszthat azzal kapcsolatban, hogyan védheti meg magát ezekkel a lehetséges kockázatokkal szemben? Szeretnénk hallani a válaszaitokat a megjegyzésekben.

Keresztül: Arstechnica